Ciberamenazas

Seguridad de la IA agéntica: riesgos de los agentes de IA y cómo defenderse a la velocidad de las máquinas

La IA agéntica está cambiando la ciberseguridad de formas para las que la mayoría de las organizaciones no están preparadas. A primera vista, parece algo ya conocido. La automatización de ataques existe desde hace años. Lo nuevo es la combinación de velocidad, autonomía y la capacidad de actuar dentro de los sistemas de los que más dependen las organizaciones.

Los empleados utilizan cada vez más agentes de IA junto con los sistemas que usan a diario: correo electrónico, plataformas de colaboración, paneles de métricas internos, CRM y herramientas de gestión de tickets. Estos agentes pueden leer mensajes, redactar respuestas, iniciar tareas y actualizar registros en múltiples sistemas. Las acciones que antes requerían que una persona revisara cada paso ahora pueden llevarse a cabo automáticamente.

La mayoría de las organizaciones ya operan con sistemas conectados, permisos delegados, flujos de trabajo automatizados y empleados que experimentan con la IA para trabajar más rápido. La IA agéntica aumenta la velocidad y la escala a la que se manifiestan estos comportamientos.

Para los equipos de seguridad, el desafío es cada vez mayor. Ya no se trata solo de si los empleados pueden reconocer y notificar un mensaje sospechoso a tiempo. También incluye si los empleados entienden cómo funciona la IA agéntica dentro de sus flujos de trabajo, a qué pueden acceder o qué pueden activar esos agentes en los distintos sistemas, y cómo podrían explotar los atacantes esos mismos flujos de trabajo.

En resumen

Este artículo presenta un ciclo de defensa adaptativa para ayudar a los responsables de ciberseguridad a responder a los ataques impulsados por la IA a medida que evolucionan. Si se utiliza bien, ese ciclo ayuda a las organizaciones a:

- Detectar nuevos ataques antes: identificar tácticas emergentes de forma temprana mediante los avisos de los empleados y las señales de amenaza.

- Entrenar contra amenazas reales: convertir ataques reales en simulaciones para que los equipos practiquen la detección del comportamiento actual de los atacantes.

- Reducir el riesgo humano mediante intervenciones: reforzar el comportamiento allí donde las acciones y los flujos de trabajo de los empleados crean la máxima exposición.

- Demostrar que la seguridad está mejorando: medir la velocidad de notificación y el riesgo de los empleados en toda la organización.

La automatización a la velocidad de las máquinas ya no es algo que esté «por llegar»

Un reciente informe de Anthropic sobre una campaña de ciberespionaje describe cómo los agentes de IA realizan aproximadamente entre el 80 y el 90 % de las operaciones tácticas con una intervención humana muy limitada. La IA agéntica se utilizó en múltiples etapas de la cadena de ataque, incluidas el reconocimiento, el análisis de vulnerabilidades y el procesamiento de datos, en lugar de solo para la redacción o la investigación. La mayoría de las organizaciones, por el contrario, todavía están tratando de proteger esos primeros casos de uso.

Al mismo tiempo, un informe de CrowdStrike muestra lo reducidos que son ya los márgenes de respuesta, con un tiempo medio de breakout de 62 minutos, y el ataque más rápido registrado se produjo en menos de 2 minutos.

En conjunto, estas señales apuntan a un cambio más amplio en el riesgo. Los equipos de ciberseguridad se enfrentan a ataques que pasan del acceso inicial a la acción más rápido de lo que muchos procesos de revisión pueden gestionar: de hecho, a la velocidad de las máquinas.

Como explica Rob Daly, director de tecnología de SoSafe, en su análisis de los ataques dirigidos por agentes: «La mayoría de los modelos de respuesta asumen que hay un pequeño margen entre la señal y la consecuencia. La ejecución dirigida por agentes reduce ese margen».

En ese entorno, la notificación temprana por parte de los empleados y la clasificación centralizada se vuelven fundamentales. Cuando los ataques se mueven con esta rapidez, la primera señal útil puede proceder de los empleados antes de que los equipos de ciberseguridad la vean en otro sitio. Por eso, los empleados deben recibir formación para reconocer el comportamiento sospechoso de la IA en las herramientas y los flujos de trabajo que utilizan a diario. Esas señales tempranas pueden dar a los equipos de seguridad los minutos necesarios para interrumpir las acciones automatizadas antes de que se propaguen por los sistemas.

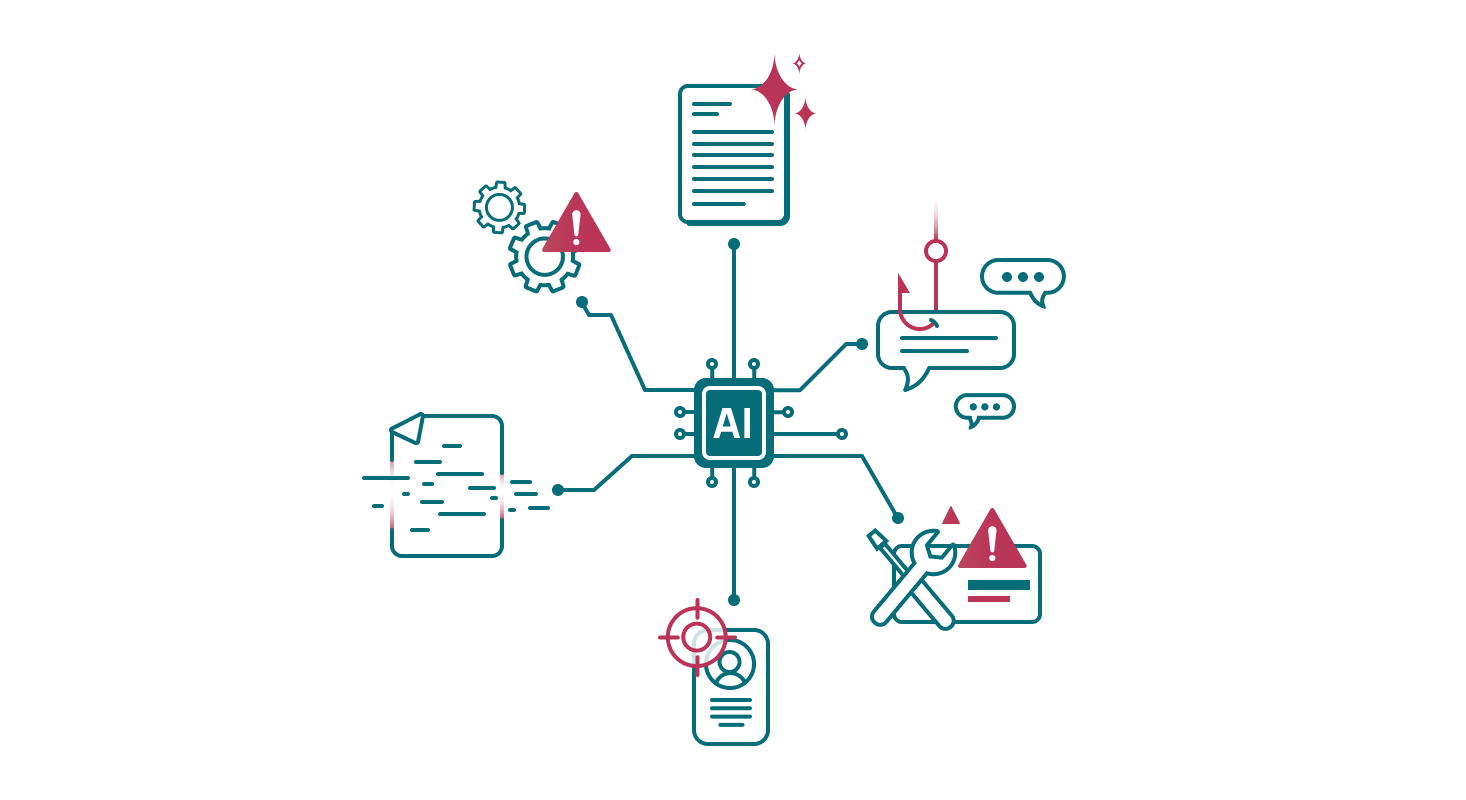

Lanzar ataques ingeniosos de IA agéntica es cada vez más fácil

Los estudios sobre la IA agéntica en ciberseguridad describen agentes que dan soporte a tareas de reconocimiento, descubrimiento de vulnerabilidades e intrusiones en varias fases. El marco de ataque de IA agéntica de Unit 42 muestra cómo los patrones de diseño inseguros y las integraciones de herramientas no seguras pueden acelerar la ejecución de ataques en los flujos de trabajo agénticos.

Lo que ahora es posible:

- Generar correos electrónicos de phishing y enviarlos a gran escala.

- Escanear redes continuamente en busca de servicios expuestos, configuraciones débiles y credenciales filtradas.

- Coordinar ataques a través de correo electrónico, SMS y teléfono.

- Mantener campañas de varios pasos durante semanas.

- Encadenar varios agentes, donde el resultado de uno alimenta al siguiente, y mucho más.

Ya has visto estas tácticas antes. La diferencia ahora es la escala. Los intentos de ataque aumentan, las campañas se repiten más rápido y las tácticas que funcionan se reutilizan antes contra tu personal.

«Antes, para ampliar una campaña cibernética era necesario añadir más personas a los teclados. La IA agéntica parece eliminar gran parte de ese trabajo pesado. Los ataques que eran tediosos de ejecutar ahora son más baratos de realizar, y además bien».

– Rob Daly, director de tecnología, SoSafe

Cuando las campañas se repiten con esta rapidez, los equipos de ciberseguridad necesitan mecanismos para convertir los nuevos patrones de ataque en acciones defensivas inmediatas. Los empleados, a su vez, deben estar preparados para reconocer cómo evolucionan estos ataques, de modo que puedan detectarlos en cuanto aparecen, y no semanas después.

Cuando los agentes de IA útiles adquieren demasiada autoridad

Muchos riesgos de seguridad de la IA agéntica comienzan como mejoras del flujo de trabajo. Un agente de IA empieza con una tarea limitada. Resulta útil. Se añade un permiso para eliminar una transferencia. A continuación, sigue otro permiso porque el proceso se ejecuta de forma más fluida de esa manera. Con el tiempo, el agente adquiere más autoridad.

La diferencia es la delegación. Un copiloto ayuda a una persona a realizar una acción. Un agente delegado, por otro lado, actúa por su cuenta dentro de los permisos que se le han otorgado. Ahí es donde la proliferación de permisos se convierte en un problema de gobernanza.

En la mayoría de los entornos, los agentes heredan modelos de permisos diseñados originalmente para personas. Si uno de esos agentes se ve comprometido, el impacto depende de la autoridad que tenga y de la rapidez con la que pueda actuar. La actividad puede seguir pareciendo legítima porque son credenciales válidas las que están realizando el trabajo.

Por eso, el privilegio mínimo para los agentes no puede ser un elemento secundario. Debe estar integrado en el sistema desde el principio. Como dice Rob Daly, es «una decisión de diseño».

Permisos temporales que se vuelven permanentes.

Derechos de ejecución que se amplían a derechos de decisión.

Acceso de visualización que se convierte en acceso de envío, cambio o activación.

En la práctica, el control suele escaparse de formas predecibles:

Estos cambios se acumulan a medida que los flujos de trabajo se automatizan más y los agentes asumen más responsabilidades.

En la práctica, esto significa centrar el refuerzo del comportamiento allí donde la autoridad y el riesgo se cruzan: en torno a los usuarios con acceso delegado, permisos elevados o la capacidad de activar flujos de trabajo operativos. Estos roles influyen en cómo se propagan las acciones a través de los sistemas. Reforzar los hábitos seguros en esos puntos contribuye a evitar que las prácticas de automatización inseguras o los comportamientos de «IA en la sombra» se extiendan por los flujos de trabajo cotidianos.

Más decisiones, menos supervisión

Las personas no toman mejores decisiones de seguridad cuando se enfrentan a un flujo constante de decisiones operativas: alertas que revisar, aprobaciones que conceder o tareas automatizadas que validar. Les cuesta todavía más cuando carecen de visibilidad sobre lo que harán esas acciones en los sistemas conectados, o cuando no está claro quién tiene la autoridad para intervenir. Los sistemas agénticos intensifican estas condiciones. Los agentes pueden generar grandes volúmenes de acciones o decisiones en poco tiempo, y así dejan que los equipos gestionen el rendimiento en lugar de ejercer un control real. En ese punto, la revisión humana se convierte en el cuello de botella.

«Cuando un agente presenta 200 decisiones por hora, el ser humano se convierte en el cuello de botella. Hay una fase en la que los humanos que quieren usar la IA pero no confían en ella sufrirán».

– Rob Daly, director de tecnología, SoSafe

Aquí es donde la defensa basada en la reacción empieza a fallar. Para cuando alguien revisa el resultado, es posible que el flujo de trabajo ya haya avanzado y que la decisión ya haya surtido efecto.

Un modelo de defensa creado para amenazas más lentas no servirá en estos casos. Los equipos necesitan un modelo de defensa que pueda detectar nuevas tácticas de ataque a tiempo, ayudar a las personas a reconocerlas rápidamente, reforzar un comportamiento más seguro en los flujos de trabajo donde aparece el riesgo y mostrar si esos esfuerzos están reduciendo la exposición con el tiempo.

Ahí es donde entran en juego las cuatro fases de la defensa adaptativa.

Ciclo de defensa adaptativa para las amenazas de la IA agéntica

Un modelo de defensa eficaz debe funcionar como un ciclo continuo.

Paso 1: Detectar

La fase de detección ayuda a los equipos de ciberseguridad a detectar nuevos patrones de ataque con la suficiente antelación para actuar sobre ellos mientras aún son recientes.

«Si ves una táctica hoy, tu entorno debería ser más difícil de explotar mañana, no el próximo trimestre».

– Rob Daly, director de tecnología, SoSafe

Esto suele empezar con algo sencillo: un empleado indica un mensaje que le parece sospechoso. Cuando esas notificaciones se centralizan en Threat Inbox, los equipos de ciberseguridad obtienen una visión instantánea de los ataques que llegan a los empleados. Esto facilita la detección temprana de tácticas de ingeniería social emergentes, phishing generado por IA y patrones de ataque multicanal, mientras todavía hay tiempo para investigar, validar y reintroducir esas señales en la defensa.

Paso 2: Replicar

La fase de réplica adapta la formación en ciberseguridad a la forma real de los ataques hoy en día.

Recreate Attack permite a los equipos de ciberseguridad convertir correos electrónicos de phishing reales o intentos de ingeniería social en simulaciones en cuestión de minutos. En lugar de depender de plantillas genéricas o escenarios obsoletos, los equipos pueden recrear las tácticas exactas observadas en su entorno y utilizarlas en programas de concienciación casi de inmediato.

Esto acorta la brecha entre detectar una táctica y preparar a las personas para ella, de modo que los empleados aprenden a reconocer los ataques que tienen más probabilidades de encontrar, no los que los atacantes utilizaron hace meses.

Paso 3: Intervenir

La fase de intervención se centra en las personas y los flujos de trabajo donde la autoridad es mayor.

Los empleados con acceso delegado, permisos elevados o la capacidad de activar flujos de trabajo operativos son los que más influyen en cómo se propagan las acciones a través de los sistemas. Por lo tanto, reforzar el comportamiento en estos roles es prioritario para reducir el riesgo.

Parte de esto significa ayudar a los propios equipos a familiarizarse con las herramientas de IA. A las personas que nunca utilizan estos sistemas a menudo les cuesta reconocer lo que pueden hacer, cuándo cambia su comportamiento o cuándo algo parece ir mal. Crear esa familiaridad ayuda a los empleados a pasar de una alfabetización básica en IA a trabajar con confianza junto a agentes que ayudan en las tareas cotidianas.

Las simulaciones específicas y las intervenciones conductuales se centran en estos usuarios de gran capacidad de acción. Ayudan a los equipos a reconocer prácticas de automatización inseguras, a cuestionar el comportamiento inusual de los agentes y a evitar los atajos de «IA en la sombra» que eluden los controles establecidos.

Paso 4: Medir

La fase de medición muestra si el ciclo de defensa está mejorando realmente la resiliencia.

Los equipos de ciberseguridad realizan un seguimiento de indicadores como la velocidad de notificación, el tiempo medio de respuesta (MTTR), la participación conductual y las señales de riesgo de los empleados utilizando métricas como el Human Security Index. Estas métricas muestran si los empleados están actuando como sensores de detección temprana y si la capacidad de respuesta mejora a medida que aparecen nuevas tácticas.

Juntas, estas fases forman un ciclo de defensa adaptativa: la detección revela nuevas tácticas, la réplica las convierte en formación, las intervenciones refuerzan el comportamiento en los flujos de trabajo correctos y la medición muestra si esos cambios están reduciendo el riesgo.

Conectar en red el ciclo de defensa

Los atacantes reutilizan lo que funciona. Los defensores deben hacer lo mismo.

Muchas organizaciones todavía aprenden de los incidentes de forma aislada. Las señales llegan lentamente, las lecciones se difunden lentamente y las mismas tácticas funcionan en otros lugares.

Cuando la notificación, la simulación, la intervención conductual y la medición están conectadas, un solo incidente se convierte en una señal de aprendizaje. La táctica puede identificarse, traducirse en refuerzo y simulación, priorizarse para usuarios o flujos de trabajo similares y seguirse para observar cambios de comportamiento.

Cuando esas señales se comparten entre organizaciones, cada incidente fortalece la red de defensa más amplia. Con el tiempo, el ecosistema en su conjunto se vuelve más difícil de explotar.

¿Todavía te defiendes a velocidad humana?

La IA agéntica cambia el riesgo en dos direcciones a la vez. Los ataques se vuelven más rápidos, baratos y fáciles de escalar, mientras que los empleados se enfrentan a un volumen de decisiones cada vez mayor y ceden más control a los sistemas que actúan en su nombre. El riesgo ya no reside únicamente en el punto de ataque. Cada vez más, se forma dentro de los flujos de trabajo y los permisos que configuran el trabajo diario.

Las organizaciones que se adapten no solo detectarán los ataques más pronto. Crearán ciclos de defensa que aprendan más rápido. Eso es lo que se necesita para seguir siendo eficaz cuando los ataques se mueven más rápido y la autoridad se traslada cada vez más a las máquinas.