Menaces cyber

Sécurité de l’IA agentique : risques des agents d’IA et comment se défendre à la vitesse de la machine

L’IA agentique transforme la cybersécurité à tel point que la plupart des entreprises n’y sont pas encore préparées. En apparence, la situation semble familière. L’automatisation des attaques existe depuis des années. Ce qui est nouveau, c’est la combinaison de la vitesse, de l’autonomie et de la capacité à agir au sein des systèmes dont les entreprises dépendent le plus.

Les collaborateurs utilisent de plus en plus d’agents IA en parallèle des systèmes qu’ils utilisent quotidiennement : messagerie, plateformes de collaboration, tableaux de bord internes, CRM et outils de gestion des tickets. Ces agents peuvent lire des messages, rédiger des réponses, déclencher des tâches et mettre à jour des enregistrements sur plusieurs systèmes. Les actions qui nécessitaient auparavant qu’une personne vérifie chaque étape peuvent désormais se dérouler automatiquement.

La plupart des entreprises fonctionnent déjà avec des systèmes connectés, des autorisations déléguées, des flux de travail automatisés et des collaborateurs qui expérimentent l’IA pour travailler plus rapidement. L’IA agentique accélère et amplifie ces comportements.

Pour les équipes de sécurité, le défi s’intensifie. Il ne s’agit plus seulement de savoir si les collaborateurs peuvent reconnaître et signaler un message suspect à temps. Il s’agit également de s’assurer que les collaborateurs comprennent comment l’IA agentique s’intègre dans leurs flux de travail, quels accès et actions ces agents peuvent déclencher sur les différents systèmes, et comment les attaquants pourraient exploiter ces mêmes flux de travail.

En bref

Cet article présente une boucle de défense adaptative destinée à aider les responsables de la sécurité à répondre aux attaques basées sur l’IA à mesure qu’elles évoluent. Bien utilisée, cette boucle aide les entreprises à :

- Repérer plus tôt les nouvelles attaques – Identifier les tactiques émergentes de manière précoce grâce aux signalements des collaborateurs et aux signaux de menaces.

- S’entraîner face à des menaces réelles – Transformer les attaques réelles en simulations afin que les équipes s’entraînent à repérer le comportement actuel des attaquants.

- Réduire le risque humain par des interventions – Renforcer les comportements dans les domaines où les actions des collaborateurs et les flux de travail créent le plus de vulnérabilité.

- Prouver que la sécurité s’améliore – Mesurer la rapidité des signalements et les risques liés au personnel à l’échelle de l’entreprise.

L’automatisation à la vitesse de la machine n’est plus « pour bientôt »

Un récent rapport d’Anthropic sur une campagne de cyberespionnage décrit des agents IA réalisant environ 80 à 90 % des opérations tactiques avec une intervention humaine très limitée. L’IA agentique a été utilisée à plusieurs étapes de la chaîne d’attaque, notamment pour la reconnaissance, l’analyse des vulnérabilités et le traitement des données, et pas seulement pour la rédaction ou la recherche. La plupart des entreprises, en revanche, tentent encore de sécuriser ces premiers cas d’usage.

Dans le même temps, un rapport de CrowdStrikemontre à quel point les délais de réponse sont déjà réduits, avec un temps moyen de propagation de 62 minutes, l’attaque la plus rapide enregistrée étant de moins de 2 minutes.

Considérés ensemble, ces signaux indiquent une évolution plus large du risque. Les équipes de sécurité sont confrontées à des attaques qui passent de l’accès initial à l’action plus rapidement que ce que de nombreux processus de vérification peuvent gérer, c’est-à-dire à la vitesse de la machine.

Comme l’explique Rob Daly, CTO de SoSafe, dans son analyse des attaques menées par des agents : « la plupart des modèles de réponse supposent qu’il y a un certain délai entre le signal et la conséquence. L’exécution pilotée par un agent réduit ce délai. »

Dans cet environnement, le signalement précoce par les collaborateurs et le triage centralisé deviennent essentiels. Lorsque les attaques évoluent aussi rapidement, le premier signal utile peut provenir du personnel avant que les équipes de sécurité ne le détectent ailleurs. Les collaborateurs doivent donc être formés à reconnaître les comportements suspects liés à l’IA dans les outils et les flux de travail qu’ils utilisent quotidiennement. Ces signaux précoces peuvent donner aux équipes de sécurité les minutes nécessaires pour interrompre les actions automatisées avant qu’elles ne se propagent dans les systèmes.

Mener des attaques élaborées par IA agentique devient plus facile

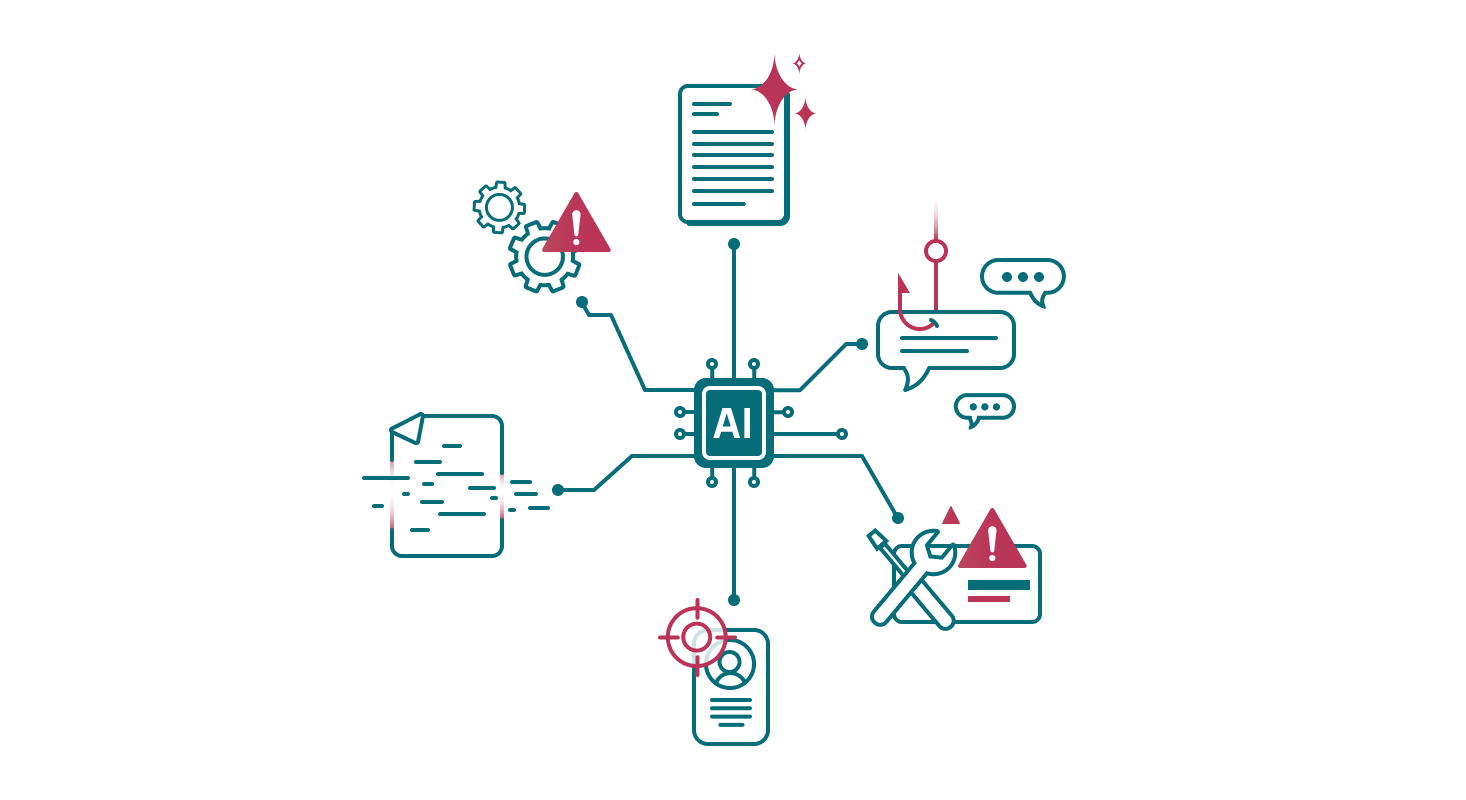

Des études sur l’IA agentique en cybersécurité montrent que les agents facilitent la reconnaissance, l’identification de vulnérabilités et les intrusions en plusieurs étapes. Le cadre d’attaque par IA agentique proposé par Unit 42 illustre comment des modèles de conception non sécurisés et des intégrations d’outils à risque peuvent accélérer l’exécution des attaques dans les flux de travail agentiques.

Ce qui est désormais possible :

- Générer des e-mails de phishing et les envoyer à très grande échelle.

- Analyser en continu les réseaux à la recherche de services exposés, de configurations faibles et d’identifiants divulgués.

- Coordonner les attaques par e-mail, SMS et téléphone.

- Conduire des campagnes en plusieurs étapes sur des semaines.

- Enchaîner plusieurs agents, la sortie de l’un alimentant le suivant, et plus encore.

Vous avez déjà vu ces tactiques. La différence aujourd’hui réside dans leur ampleur. Les tentatives d’attaque se multiplient, les campagnes s’enchaînent plus rapidement et les tactiques efficaces sont réutilisées plus tôt contre vos collaborateurs.

« Déployer une campagne cyber à grande échelle impliquait autrefois de mobiliser davantage de personnes derrière les claviers. L’IA agentique semble éliminer une grande partie de ce travail fastidieux. Des attaques auparavant complexes à exécuter deviennent moins coûteuses à mener efficacement. »

– Rob Daly, CTO, SoSafe

Lorsque les campagnes s’enchaînent à un tel rythme, les équipes de sécurité ont besoin de mécanismes permettant de transformer les nouveaux schémas d’attaque en mesures défensives immédiates. Les collaborateurs, à leur tour, doivent être prêts à reconnaître l’évolution de ces attaques afin de pouvoir les repérer dès leur apparition, et non des semaines plus tard.

Quand les agents IA utiles ont trop de privilèges

De nombreux risques pour la sécurité liés à l’IA agentique commencent comme des améliorations de flux de travail. Un agent d’IA commence avec une tâche limitée. Il s’avère utile. Une autorisation est ajoutée pour supprimer une étape de transfert. Puis une autre est ajoutée parce que le processus devient plus fluide ainsi. Au fil du temps, l’agent acquiert plus de privilèges.

La différence, c’est la délégation. Un copilote assiste l’action d’une personne. Un agent délégué, en revanche, agit de manière autonome dans les limites des autorisations qui lui ont été accordées. C’est à ce niveau que la prolifération des privilèges devient un problème de gouvernance.

Dans la plupart des environnements, les agents héritent de modèles d’autorisation initialement conçus pour les personnes. Si l’un de ces agents est compromis, l’impact dépend du niveau de privilèges dont il dispose et de la rapidité avec laquelle il peut agir. L’activité peut néanmoins sembler légitime, car elle repose sur des identifiants valides.

C’est pourquoi le principe du moindre privilège appliqué aux agents ne peut pas être traité après coup. Il doit être intégré au système dès le départ. Comme le souligne Rob Daly, c’est « une décision de conception ».

Des autorisations temporaires qui deviennent permanentes.

Des droits d’exécution qui s’étendent à des droits de décision.

Un accès en lecture qui se transforme en accès d’envoi, de modification ou de déclenchement.

En pratique, le contrôle échappe généralement de manière prévisible :

Ces changements s’accumulent à mesure que les flux de travail deviennent plus automatisés et que les agents assument plus de responsabilités.

En pratique, cela signifie concentrer le renforcement comportemental au croisement des privilèges et du risque : auprès des utilisateurs disposant d’un accès délégué, de privilèges élevés ou de la capacité à déclencher des flux de travail opérationnels. Ces rôles influencent la manière dont les actions se propagent à travers les systèmes. Le renforcement d’habitudes sûres à ces niveaux contribue à empêcher que des pratiques d’automatisation dangereuses ou des comportements de « shadow AI » ne se propagent dans les flux de travail quotidiens.

Plus de décisions, moins de supervision

Les utilisateurs ne prennent pas de meilleures décisions en matière de sécurité lorsqu’ils sont confrontés à un flux constant de décisions opérationnelles : des alertes à examiner, des approbations à accorder ou des tâches automatisées à valider. Ils rencontrent encore plus de difficultés lorsqu’ils manquent de visibilité sur les conséquences de ces actions sur l’ensemble des systèmes connectés, ou lorsque les responsabilités d’intervention ne sont pas clairement définies. Les systèmes agentiques intensifient ces conditions. Les agents peuvent générer de grands volumes d’actions ou de décisions en peu de temps, laissant les équipes gérer le débit plutôt que d’exercer un contrôle réel. À ce stade, la vérification humaine devient le goulet d’étranglement.

« Lorsqu’un agent génère 200 décisions par heure, l’humain constitue le facteur limitant. À un certain stade, les personnes qui souhaitent utiliser l’IA mais qui ne lui font pas confiance vont se retrouver rapidement en difficulté. »

– Rob Daly, CTO, SoSafe

C’est là que la défense basée sur la réaction commence à montrer ses limites. Le temps que quelqu’un examine le résultat, le flux de travail a peut-être déjà progressé et la décision peut déjà avoir pris effet.

Un modèle de défense conçu pour des menaces plus lentes sera mis en difficulté dans ce contexte. Les équipes ont besoin d’un modèle capable d’identifier rapidement les nouvelles stratégies d’attaque, d’aider les utilisateurs à les reconnaître, de renforcer les comportements sûrs dans les flux de travail où le risque apparaît, et de démontrer que ces actions réduisent l’exposition dans le temps.

C’est là qu’interviennent les quatre étapes de la défense adaptative.

Boucle de défense adaptative pour les menaces d’IA agentique

Un modèle de défense efficace doit fonctionner en boucle continue.

Étape 1 : Détecter

La phase de détection permet aux équipes de sécurité d’identifier de nouveaux schémas d’attaque suffisamment tôt pour agir tant qu’ils sont encore récents.

« Si vous identifiez une tactique aujourd’hui, votre environnement devrait être plus difficile à exploiter dès demain, et non au prochain trimestre. »

– Rob Daly, CTO, SoSafe

Tout commence souvent par quelque chose de simple : un collaborateur signale un message qui lui semble suspect. Lorsque ces signalements sont centralisés dans Threat Inbox, les équipes de sécurité bénéficient d’une vue en temps réel des attaques qui touchent le personnel. Il est ainsi plus facile de repérer à un stade précoce les nouvelles tactiques d’ingénierie sociale, le phishing généré par l’IA et les schémas d’attaque multicanaux, tant qu’il est encore temps d’enquêter, de valider et de réinjecter ces signaux dans les systèmes de défense.

Étape 2 : Reproduire

L’étape de reproduction permet d’aligner la formation à la sécurité sur la réalité des attaques actuelles.

Recreate Attack permet aux équipes de sécurité de transformer de véritables e-mails de phishing ou des tentatives d’ingénierie sociale en simulations en quelques minutes. Au lieu de s’appuyer sur des modèles génériques ou des scénarios obsolètes, les équipes peuvent recréer les tactiques exactes observées dans leur environnement et les utiliser quasi immédiatement dans des programmes de sensibilisation.

Cete approche réduit le délai entre la détection d’une tactique et la préparation des personnes pour y faire face, de sorte que les collaborateurs apprennent à reconnaître les attaques qu’ils sont les plus susceptibles de rencontrer, et non celles utilisées par les attaquants il y a plusieurs mois.

Étape 3 : Intervenir

L’étape d’intervention se concentre sur les personnes et les flux de travail présentant les niveaux de privilèges les plus élevés.

Les collaborateurs disposant d’un accès délégué, de privilèges élevés ou de la capacité à déclencher des flux de travail opérationnels ont le plus d’influence sur la propagation des actions à travers les systèmes. Renforcer les comportements dans ces rôles a donc le plus fort impact sur la réduction du risque.

Une partie de cette démarche consiste à aider les équipes à se familiariser elles-mêmes avec les outils d’IA. Les personnes qui n’utilisent jamais ces systèmes ont souvent du mal à comprendre ce qu’ils peuvent faire, à détecter les changements de comportement ou à identifier ce qui semble anormal. Développer cette familiarité permet aux collaborateurs de passer d’une culture de base de l’IA à une utilisation en toute confiance avec des agents qui les assistent dans leurs tâches quotidiennes.

Des simulations ciblées et des interventions comportementales se concentrent sur ces utilisateurs à forte capacité d’action. Elles aident les équipes à identifier les pratiques d’automatisation à risque, à remettre en question les comportements inhabituels des agents et à éviter les raccourcis de « shadow AI » qui contournent les contrôles établis.

Étape 4 : Mesurer

L’étape de mesure permet de déterminer si la boucle de défense améliore réellement la résilience.

Les équipes de sécurité suivent des indicateurs tels que la rapidité de signalement, le temps moyen de réponse (MTTR), l’engagement comportemental et les signaux de risque liés aux collaborateurs, à l’aide d’indicateurs comme le Human Security Index. Ces mesures permettent de voir si les collaborateurs agissent comme des capteurs de détection précoce et si la capacité de réponse s’améliore à mesure que de nouvelles tactiques apparaissent.

L’ensemble de ces étapes forme une boucle de défense adaptative : la détection révèle de nouvelles tactiques, la reproduction les transforme en formation, les interventions renforcent les comportements dans les bons flux de travail, et la mesure permet de vérifier si ces actions réduisent le risque.

Mettre en réseau la boucle de défense

Les attaquants réutilisent ce qui fonctionne. Les défenseurs doivent faire de même.

De nombreuses entreprises tirent encore des leçons des incidents de manière isolée. Les signaux arrivent lentement, les enseignements se diffusent lentement, et les mêmes tactiques réussissent ailleurs.

Lorsque le signalement, la simulation, l’intervention comportementale et la mesure sont connectés, un seul incident devient un signal d’apprentissage. La tactique peut être identifiée, traduite en renforcement et en simulation, priorisée pour des utilisateurs ou des flux de travail similaires, puis suivie pour mesurer un changement de comportement.

Lorsque ces signaux sont partagés entre les entreprises, chaque incident renforce le réseau de défense global. Au fil du temps, l’écosystème dans son ensemble devient plus difficile à exploiter.

Vous défendez-vous toujours à vitesse humaine ?

L’IA agentique modifie le risque dans deux directions à la fois. Les attaques deviennent plus rapides, moins chères et plus faciles à déployer à grande échelle, tandis que les collaborateurs sont confrontés à un volume de décisions croissant et délèguent davantage de contrôle à des systèmes agissant en leur nom. Le risque ne se situe plus seulement au point d’attaque. Il se forme de plus en plus au sein des flux de travail et des autorisations qui façonnent le travail quotidien.

Les entreprises qui s’adaptent ne se contenteront pas de détecter les attaques plus rapidement. Elles construiront des boucles de défense capables d’apprendre plus vite. C’est ce qu’il faut pour rester efficace face à des attaques de plus en plus rapides et à un transfert croissant des privilèges vers les machines.