Cyber Security Gefahren

Agentenbasierte KI und das Thema Sicherheit: Risiken von KI-Agenten und Verteidigung im Tempo der Maschinen

Agentische KI verändert die Cybersicherheit auf eine Weise, auf die die meisten Unternehmen nicht vorbereitet sind. Oberflächlich betrachtet wirkt die Situation vertraut. Angriffsautomatisierung gibt es schon seit Jahren. Neu ist jedoch die Kombination aus Geschwindigkeit, Autonomie und der Fähigkeit der Angreifenden, in den Systemen zu agieren, auf die Unternehmen am meisten angewiesen sind.

Mitarbeitende nutzen zunehmend KI-Agenten neben den Systemen, mit denen sie tagtäglich arbeiten: E-Mail, Kollaborationsplattformen, interne Dashboards, CRMs und Ticketing-Tools. Diese Agenten können Nachrichten lesen, Antworten entwerfen, Aufgaben auslösen und Datensätze systemübergreifend aktualisieren. Aktionen, bei denen früher jeder Schritt von einer Person überprüft werden musste, können jetzt automatisch ablaufen.

Die meisten Unternehmen arbeiten bereits mit vernetzten Systemen, delegierten Berechtigungen und automatisierten Arbeitsabläufen, und Mitarbeitende experimentieren mit KI, um schneller zu arbeiten. Agentenbasierte KI erhöht die Geschwindigkeit und das Ausmaß, in dem sich diese Verhaltensweisen auswirken.

Für Sicherheitsteams wird die Herausforderung größer. Es geht nicht mehr nur darum, ob Mitarbeitende eine verdächtige Nachricht rechtzeitig erkennen und melden können. Es geht auch darum, ob Mitarbeitende verstehen, wie agentenbasierte KI in ihren Arbeitsabläufen funktioniert, worauf diese Agenten systemübergreifend zugreifen oder was sie auslösen können und wie Angreifer die Arbeitsabläufe ausnutzen könnten.

TL;DR

Dieser Artikel stellt einen adaptiven Verteidigungskreislauf vor, der Sicherheitsverantwortlichen hilft, auf sich weiterentwickelnde KI-gesteuerte Angriffe zu reagieren. Wenn er richtig eingesetzt wird, ermöglicht dieser Kreislauf Unternehmen Folgendes:

- Neue Angriffe früher erkennen – Aufkommende Taktiken frühzeitig durch Meldungen von Mitarbeitenden und Bedrohungssignale identifizieren.

- Mithilfe von realen Bedrohungen lernen – Echte Angriffe in Simulationen umwandeln, damit Teams das Erkennen aktueller Angreiferverhalten üben.

- Menschlich bedingtes Risiko durch Interventionen reduzieren – Verhalten dort stärken, wo Handlungen von Mitarbeitenden und Arbeitsabläufe die größte Angriffsfläche bieten.

- Sicherheitsverbesserungen nachweisen – Die Meldegeschwindigkeit und das Risiko der Belegschaft im gesamten Unternehmen messen.

Automatisierung im Tempo der Maschinen ist nicht mehr nur Zukunftsmusik

Ein aktueller Anthropic-Report über eine Cyberspionage-Kampagne beschreibt, wie KI-Agenten rund 80–90 % der taktischen Operationen mit sehr begrenztem menschlichen Eingreifen durchführen. Agentenbasierte KI wurde in mehreren Phasen der Angriffskette eingesetzt, einschließlich Aufklärung, Schwachstellenanalyse und Datenverarbeitung, anstatt nur für Entwürfe oder Recherchen. Die meisten Unternehmen hingegen versuchen immer noch, diese frühen Anwendungsfälle abzusichern.

Gleichzeitig zeigt ein CrowdStrike-Report, wie eng die Reaktionsfenster bereits sind, mit einer durchschnittlichen Breakout-Zeit von 62 Minuten, wobei der schnellste erfasste Angriff unter 2 Minuten dauerte.

Zusammengenommen deuten diese Signale auf eine breitere Risikoverlagerung hin. Sicherheitsteams haben es mit Angriffen zu tun, die vom ersten Zugriff bis zur Aktion schneller ablaufen, als viele Überprüfungsprozesse bewältigen können – effektiv mit Maschinengeschwindigkeit.

Wie Rob Daly, CTO bei SoSafe, in seiner Analyse von agentengesteuerten Angriffen erklärt: „Die meisten Reaktionsmodelle gehen davon aus, dass zwischen Signal und Konsequenz etwas Luft ist. Die agentengesteuerte Ausführung verringert diese Lücke.“

In diesem Umfeld werden frühzeitige Meldungen durch Mitarbeitende und eine zentralisierte Triage entscheidend. Wenn Angriffe so schnell ablaufen, kann das erste nützliche Signal von der Belegschaft kommen, bevor Sicherheitsteams es an anderer Stelle sehen. Mitarbeitende müssen daher geschult werden, verdächtiges KI-Verhalten in den Tools und Arbeitsabläufen zu erkennen, die sie täglich verwenden. Diese frühen Signale können den Sicherheitsteams die nötigen Minuten verschaffen, um automatisierte Aktionen zu unterbrechen, bevor sie sich über Systeme ausbreiten.

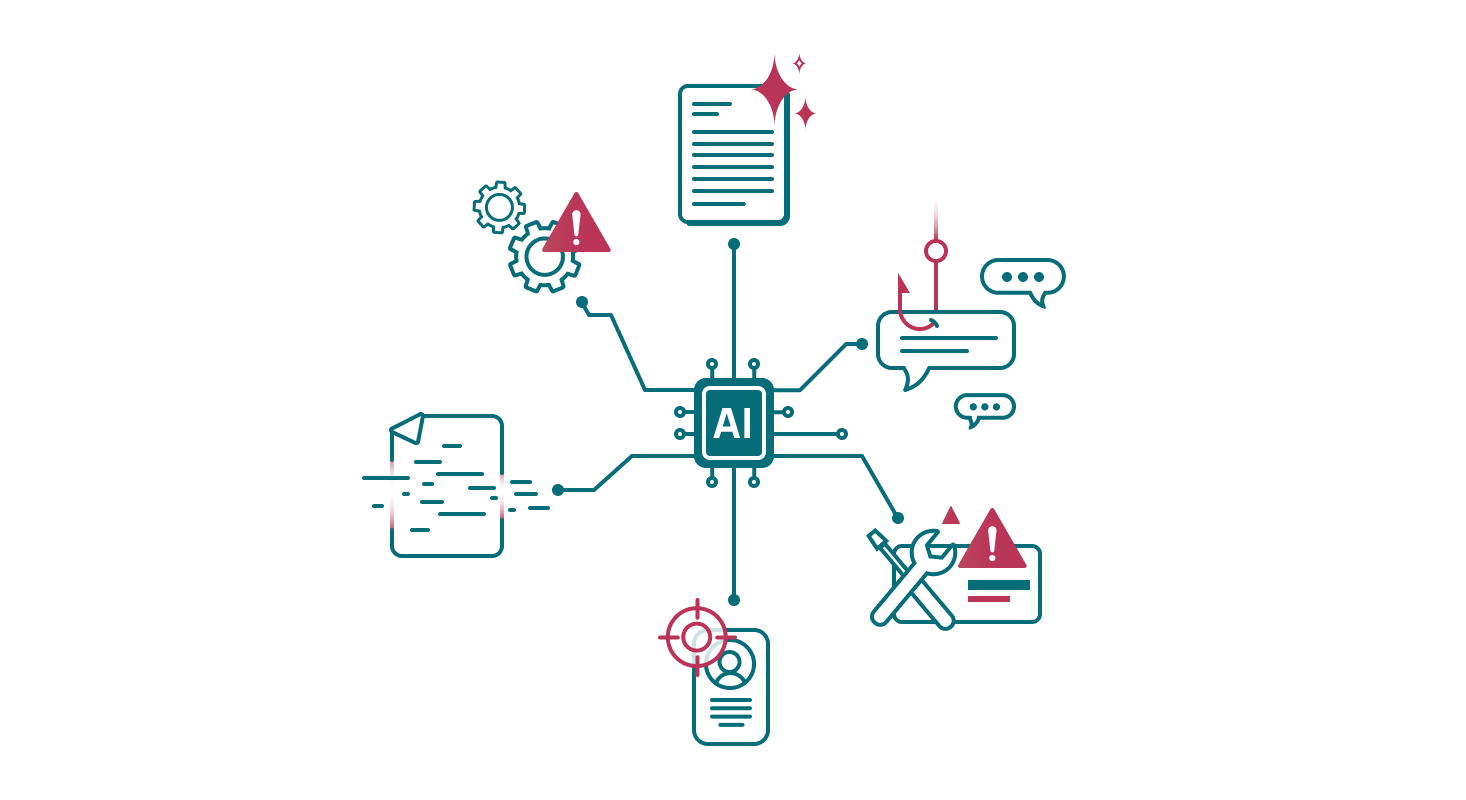

Die Durchführung raffinierter agentengesteuerter KI-Angriffe wird einfacher

Studien zu agentenbasierter KI in der Cybersicherheit beschreiben Agenten, die Aufklärung, die Entdeckung von Schwachstellen und mehrstufige Angriffe unterstützen. Das agentengesteuerte KI-Angriffs-Framework von Unit 42 zeigt, wie unsichere Designmuster und unsichere Tool-Integrationen die Ausführung von Angriffen über agentengesteuerte Arbeitsabläufe hinweg beschleunigen können.

Mittlerweile ist Folgendes möglich:

- Phishing-Mails in großem Umfang generieren und versenden.

- Netzwerke kontinuierlich auf ungeschützte Dienste, schwache Konfigurationen und geleakte Anmeldedaten scannen.

- Angriffe über E-Mail, SMS und Telefon koordinieren.

- Mehrstufige Kampagnen über Wochen aufrechterhalten.

- Mehrere Agenten miteinander verketten, wobei der Output des einen den nächsten speist, und mehr.

Diese Taktiken sind Ihnen vermutlich bereits begegnet. Der Unterschied ist jetzt das Ausmaß. Angriffsversuche nehmen zu, Kampagnen wiederholen sich schneller und erfolgreiche Taktiken werden früher bei Ihrer Belegschaft wiederverwendet.

„Eine Cyberangriffskampagne zu skalieren bedeutete früher, mehr Leute hinter die Tastaturen zu setzen. Agentische KI scheint einen Großteil dieser mühsamen Arbeit unnötig zu machen. Angriffe, deren Durchführung bislang mühsam war, können jetzt kostengünstig erfolgreich ausgeführt werden.“

– Rob Daly, CTO, SoSafe

Wenn sich Kampagnen so schnell wiederholen, benötigen Sicherheitsteams Mechanismen, um neue Angriffsmuster in sofortige Abwehrmaßnahmen umzusetzen. Mitarbeitende wiederum müssen darauf vorbereitet sein, zu erkennen, wie sich diese Angriffe entwickeln, damit sie sie erkennen, wenn sie auftreten, und nicht erst Wochen später.

Wenn hilfreiche KI-Agenten zu viel Autorität erlangen

Viele Sicherheitsrisiken durch agentische KI beginnen als Verbesserungen von Arbeitsabläufen. Mitarbeitende nutzen einen KI-Agenten für eine eng begrenzte Aufgabe. Er erweist sich als nützlich. Eine Berechtigung wird hinzugefügt, da ansonsten ein Mensch übernehmen müsste. Dann folgt eine weitere Berechtigung, weil der Prozess so reibungsloser abläuft. Mit der Zeit erhält der Agent mehr Autorität.

Der Unterschied liegt in der Vergabe von Rechten und Verantwortung. Eine KI, die als Assistent agiert, unterstützt die Handlungen einer Person. Ein delegierter Agent hingegen handelt eigenständig im Rahmen der ihm erteilten Berechtigungen. An diesem Punkt wird die Ausuferung von Berechtigungen zu einem Governance-Problem.

In den meisten Umgebungen erben Agenten Berechtigungsmodelle, die ursprünglich für Menschen entwickelt wurden. Wenn einer dieser Agenten kompromittiert wird, hängt die Auswirkung davon ab, wie viel Autorität er hat und wie schnell er handeln kann. Eine von ihm ausgeführte Aktivität kann immer noch legitim aussehen, da die Arbeit mit gültigen Anmeldeinformationen ausgeführt wird.

Deshalb darf das Prinzip der geringsten Rechtevergabe für Agenten nicht nur ein Nebengedanke sein. Es muss von Anfang an in das System integriert werden. Wie Rob Daly es ausdrückt, handelt es sich um eine „Designentscheidung“.

Temporäre Berechtigungen, die dauerhaft werden.

Ausführungsrechte, die sich zu Entscheidungsrechten ausweiten.

Anzeigezugriff, der sich in Sende-, Änderungs- oder Auslösezugriff verwandelt.

In der Praxis entgleitet die Kontrolle normalerweise auf vorhersehbare Weise:

Diese Änderungen häufen sich an, da die Workflows zunehmend automatisiert werden und Agenten mehr Verantwortung übernehmen.

In der Praxis bedeutet dies, die Verhaltensverstärkung dort zu konzentrieren, wo Autorität und Risiko aufeinandertreffen: bei Nutzenden mit delegiertem Zugriff, erweiterten Berechtigungen oder der Fähigkeit, operative Arbeitsabläufe auszulösen. Diese Rollen beeinflussen, wie sich Aktionen über Systeme hinweg ausbreiten. Die Stärkung sicherer Gewohnheiten an diesen Punkten hilft zu verhindern, dass sich unsichere Automatisierungspraktiken oder „Schatten-KI“-Verhaltensweisen in alltäglichen Arbeitsabläufen ausbreiten.

Mehr Entscheidungen, weniger Kontrolle

Menschen treffen keine besseren Sicherheitsentscheidungen, wenn sie mit einem ständigen Strom von operativen Entscheidungen konfrontiert sind: Sie müssen fortlaufend Warnmeldungen prüfen, Genehmigungen erteilen oder automatisierte Aufgaben validieren. Noch größere Schwierigkeiten haben sie, wenn ihnen die Sichtbarkeit dafür fehlt, was diese Aktionen in verbundenen Systemen bewirken werden, oder wenn unklar ist, wer die Befugnis hat, einzugreifen. Agentische Systeme verstärken diese Bedingungen. Agenten können in kurzer Zeit große Mengen an Aktionen oder Entscheidungen generieren, sodass die Teams mühsam all diese Aktionen verwalten, anstatt echte Kontrolle auszuüben. An diesem Punkt wird die menschliche Überprüfung zum Engpass.

„Wenn ein Agent 200 Entscheidungen pro Stunde trifft, wird der Mensch zum Engpass. Es gibt eine Phase, in der Menschen, die KI nutzen wollen, ihr aber nicht vertrauen, leiden werden.“

– Rob Daly, CTO, SoSafe

An dieser Stelle beginnt die reaktionsbasierte Verteidigung zu versagen. Bis jemand das Ergebnis überprüft, ist der Workflow möglicherweise bereits fortgeschritten und die Entscheidung bereits in Kraft getreten.

Ein Verteidigungsmodell, das für langsamere Bedrohungen ausgelegt ist, wird hier Schwierigkeiten haben. Teams benötigen ein Verteidigungsmodell, das neue Angriffstaktiken frühzeitig entdecken kann, Menschen hilft, sie schnell zu erkennen, sichereres Verhalten in den Workflows stärkt, in denen Risiken auftreten, und zeigt, ob diese Bemühungen die Gefährdung im Laufe der Zeit verringern.

Hier kommen die vier Stufen der adaptiven Verteidigung ins Spiel.

Adaptive Verteidigungsschleife für agentische KI-Bedrohungen

Ein effektives Verteidigungsmodell muss als kontinuierliche Schleife funktionieren.

Schritt 1: Erkennen

Die Erkennungsphase hilft Sicherheitsteams, neue Angriffsmuster früh genug zu erkennen, um darauf zu reagieren, während sie noch frisch sind.

„Wenn Ihnen heute eine Angriffstaktik begegnet, sollte schon morgen Ihre Umgebung schwerer auszunutzen sein, nicht erst im nächsten Quartal.“

– Rob Daly, CTO, SoSafe

Oft beginnt dies ganz einfach: Mitarbeitende melden eine Nachricht, die sich seltsam anfühlt. Wenn diese Meldungen in Threat Inbox zentralisiert werden, erhalten Sicherheitsteams eine Live-Ansicht der Angriffe, die die Belegschaft erreichen. Das erleichtert es, aufkommende Social-Engineering-Taktiken, KI-generiertes Phishing und kanalübergreifende Angriffsmuster frühzeitig zu erkennen, während noch Zeit bleibt, diese Signale zu untersuchen, zu validieren und in die Verteidigung zurückzuspeisen.

Schritt 2: Spiegeln

Die Spiegelungsphase sorgt dafür, dass das Security-Training daran angepasst ist, wie Angriffe heute tatsächlich aussehen.

Mit Recreate Attack können Sicherheitsteams echte Phishing-Mails oder Social-Engineering-Versuche innerhalb von Minuten in Simulationen umwandeln. Anstatt sich auf generische Vorlagen oder veraltete Szenarien zu verlassen, können Teams die genauen Taktiken, die in ihrer Umgebung beobachtet wurden, nachbilden und sie fast sofort in Awareness-Programmen einsetzen.

Dies verkürzt die Lücke zwischen dem Erkennen einer Taktik und der Vorbereitung der Belegschaft auf genau diese Taktik. So lernen Mitarbeitende, die Angriffe zu erkennen, denen sie zum aktuellen Zeitpunkt am wahrscheinlichsten begegnen werden, und nicht diejenigen, die Angreifer vor Monaten verwendet haben.

Schritt 3: Intervenieren

Die Interventionsphase konzentriert sich auf die Menschen und Workflows, die die höchste Autorität beziehungsweise die breitesten Berechtigungen haben.

Mitarbeitende mit delegiertem Zugriff, erweiterten Berechtigungen oder der Möglichkeit, operative Arbeitsabläufe auszulösen, haben den größten Einfluss darauf, wie sich Aktionen über Systeme hinweg ausbreiten. Die Stärkung des Verhaltens in diesen Rollen hat daher die größte Auswirkung auf die Risikominderung.

Dies bedeutet auch, den Teams zu helfen, sich selbst mit KI-Tools vertraut zu machen. Menschen, die diese Systeme nie benutzen, haben oft Schwierigkeiten zu erkennen, was sie tun können, wann sich ihr Verhalten ändert oder wann etwas falsch aussieht. Der Aufbau von Vertrautheit hilft den Mitarbeitenden, von grundlegenden KI-Kenntnissen zu einer selbstbewussten Zusammenarbeit mit den Agenten überzugehen, die ihnen bei alltäglichen Aufgaben helfen.

Gezielte Simulationen und Verhaltensinterventionen konzentrieren sich auf diese User mit hoher Handlungsbefugnis. Sie helfen Teams, unsichere Automatisierungspraktiken zu erkennen, ungewöhnliches Agentenverhalten zu hinterfragen und „Schatten-KI“-Abkürzungen zu vermeiden, die etablierte Kontrollen umgehen.

Schritt 4: Messen

Die Messphase zeigt, ob die Verteidigungsschleife die Widerstandsfähigkeit tatsächlich verbessert.

Sicherheitsteams verfolgen Indikatoren wie die Meldegeschwindigkeit, die mittlere Reaktionszeit (MTTR), das Verhaltensengagement und Risikosignale der Belegschaft anhand von Metriken wie dem Human Security Index. Diese Metriken zeigen, ob Mitarbeitende als Früherkennungssensoren agieren und ob sich die Reaktionsfähigkeit bei neuen Taktiken verbessert.

Zusammen bilden diese Stufen eine adaptive Verteidigungsschleife: Die Erkennung deckt neue Taktiken auf, das Spiegeln verwandelt sie in Trainings, Interventionen stärken das Verhalten in den richtigen Workflows und die Messung zeigt, ob diese Änderungen das Risiko verringern.

Vernetzung der Verteidigungsschleife

Angreifer verwenden wieder, was funktioniert. Verteidiger müssen dasselbe tun.

Viele Organisationen lernen immer noch isoliert aus Vorfällen. Signale kommen nur langsam an, Gelerntes verbreitet sich ebenso langsam, und so geschieht es schnell, dass die beobachteten Angriffstaktiken an anderer Stelle erneut erfolgreich sind.

Wenn Reporting, Simulation, Verhaltensintervention und Messung miteinander verbunden sind, wird ein einzelner Vorfall zu einem Lernsignal. Die Taktik kann identifiziert, in Verstärkung und Simulation umgesetzt, für ähnliche User oder Workflows priorisiert und auf Verhaltensänderungen hin verfolgt werden.

Wenn diese Signale organisationsübergreifend geteilt werden, stärkt jeder Vorfall das gesamte Verteidigungsnetzwerk. Im Laufe der Zeit wird das gesamte Ökosystem schwerer auszunutzen.

Verteidigen Sie sich immer noch in menschlicher Geschwindigkeit?

Agentenbasierte KI verändert das Risiko in zwei Richtungen gleichzeitig. Angriffe werden schneller, billiger und einfacher zu skalieren, während Mitarbeitende mit einem wachsenden Entscheidungsvolumen konfrontiert sind und mehr Kontrolle an Systeme abgeben, die in ihrem Namen handeln. Das Risiko liegt nicht mehr nur am Angriffspunkt. Es entsteht zunehmend innerhalb der Workflows und Berechtigungen, die die tägliche Arbeit prägen.

Organisationen, die sich anpassen, werden Angriffe nicht nur schneller erkennen. Sie werden Verteidigungsschleifen aufbauen, die schneller lernen. Genau das ist notwendig, um effektiv zu bleiben, wenn Angriffe schneller werden und die Autorität zunehmend auf Maschinen übergeht.